AIと軍事利用の最前線:何が起きているのか

2025年から2026年にかけて、AIと軍事利用をめぐる動きが急速に加速しています。AnthropicやOpenAIといった主要なAI企業が米国防総省(ペンタゴン)との関係を深め、その実態がメディアで報じられるようになりました。MIT Technology Reviewの「AI Hype Index」シリーズでも、AIが戦争へと向かう潮流が特集されています。本セクションでは、具体的にどのような出来事が起きているのかを整理します。

AnthropicとペンタゴンのClaude兵器化を巡る対立

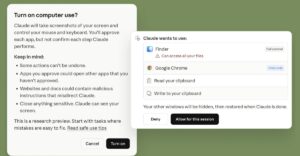

Anthropicは、AIの安全性と倫理的な開発を掲げて設立された企業です。しかし、そのAnthropicと米国防総省(ペンタゴン)の間で、Anthropicが開発するAIモデル「Claude」の兵器化をめぐる対立が表面化したとMIT Technology Reviewは報じています。

具体的にどのような条件や用途をめぐって意見が衝突したかについては現時点では詳細が公表されていませんが、「AIを軍事目的にどこまで活用できるか」という根本的な問いが、企業と政府機関の間で議論になっていることは明らかです。倫理的なAI開発を標榜する企業が、軍事用途に踏み込む際の境界線はどこにあるのか、業界全体が注目する問題となっています。

この対立は、AI企業が掲げる理念と、国家安全保障上の要請との間にある深い溝を象徴しています。特にClaudeは対話型AIとして広く利用されており、その技術が攻撃的な軍事目的に転用されることへの懸念は、社内外から多く上がっているとされています。

OpenAIと国防総省の「機会主義的」な契約とは

OpenAIは、Anthropicとペンタゴンの対立をよそに、米国防総省との契約を締結したことがMIT Technology Reviewで報じられています。同メディアはこの契約を「opportunistic and sloppy(機会主義的で杜撰)」と表現しており、慎重な検討よりも速度を優先したとの見方を示しています。

Anthropicとペンタゴンの関係がこじれた隙間を突くようにOpenAIが動いたという構図は、AI業界における政府契約をめぐる競争の激しさを示しています。国防総省はAI技術を迅速に取り込もうとしており、各社の競合関係がその動きに拍車をかけている状況です。

「機会主義的」と評された背景には、利用規約やリスク評価が十分に整備されないまま契約が進んだ可能性が指摘されています。軍事目的でのAI活用は、民間利用とは比較にならないリスクを伴うため、プロセスの透明性と慎重さが求められます。それが十分でなかったとすれば、将来的に深刻な問題へ発展する可能性があります。

倫理を掲げたAnthropicがなぜ軍事協力に踏み切ったのか

「安全なAI開発」を企業の核心に置いてきたAnthropicが、軍事分野への協力へと舵を切った経緯は、多くの関係者に衝撃を与えました。MIT Technology Reviewは「Anthropic—the company founded to be ethical—is now turbocharging US strikes on Iran(倫理的であるために設立された企業が、今や米国のイラン攻撃を加速させている)」と端的に表現しています。この章では、設立理念と現実の間にあるギャップと、軍事協力の具体的な内容を確認します。

Anthropicの設立理念と現実のギャップ

Anthropicは、OpenAIの元メンバーが中心となって設立した企業で、AIの安全性(AI Safety)を最重要課題に掲げてきました。「責任あるAI開発」を企業の存在意義として発信し、Claudeの設計においても有害なコンテンツ生成の抑制やバイアス排除に力を入れてきた経緯があります。

しかし、その企業が米国防総省と協力関係を持ち、軍事作戦への技術的な貢献を行うに至ったという事実は、設立当初の理念との間に大きなギャップを生じさせています。「倫理的なAI」を掲げることと、国家の軍事力を増強することは、根本的に相容れないとする見方もあります。

AI企業にとって、政府や軍との契約は財政的に大きな意味を持ちます。膨大な計算資源と研究投資を必要とするAI開発において、政府からの資金調達は無視できない現実です。理念と経営の間で難しい判断を迫られる構造は、AnthropicだけでなくAI業界全体が直面している課題といえます。

米国のイラン攻撃支援とAIの役割

MIT Technology Reviewの報道によれば、AnthropicのAI技術は米国によるイランへの攻撃を「加速(turbocharging)」する形で活用されたとされています。AIが実際の軍事作戦において具体的にどのような役割を果たしたかについての詳細は、安全保障上の理由から多くが非公開です。

ただし、一般的にAI技術が軍事作戦で担いうる役割としては、情報収集・分析の高速化、目標識別の補助、作戦計画の立案支援などが挙げられます。こうした用途において、高度な自然言語処理能力を持つClaude系のモデルが活用されることは技術的に想定の範囲内です。

AIが実際の攻撃に関与したとなれば、「致死的自律型兵器(LAWS)」規制の議論とも接続する問題です。国際的な議論が追いつかないスピードでAIが軍事転用されていく現状は、専門家の間でも強い懸念を呼んでいます。

ChatGPT離れと社会的反発:QuitGPTキャンペーンとロンドン抗議

AIの軍事化や政権との関係が明らかになるにつれ、一般ユーザーや市民社会からの反発も強まっています。MIT Technology Reviewは、多数のユーザーがChatGPTを解約する動きや、ロンドンで起きたAIへの大規模抗議デモについても報じています。技術への不信感が、具体的な行動として現れ始めた局面です。

ユーザーがChatGPTを退会する理由

MIT Technology Reviewによれば、「QuitGPT(チャットGPTをやめよう)」と題したキャンペーンが展開され、多くのユーザーがChatGPTのサブスクリプションを解約する動きが起きています。このキャンペーンは、OpenAIの米国移民・関税執行局(ICE)との連携に対する反発を一つのきっかけとして広がったとされています。

解約の理由はICEとの関係だけにとどまりません。OpenAIが米国防総省と締結した「機会主義的」な契約への反感、トランプ政権との距離感への懸念、そしてAI企業が営利優先で倫理を後回しにしているという不信感など、複合的な要因が重なっています。

ユーザーが感じる「自分が使うAIツールが、自分の望まない目的に使われている」という違和感は、テクノロジーと政治・軍事の関係が可視化された時代ならではの感情です。こうした動きはサービスの評判に直接影響し、企業のブランド戦略にも無視できない圧力をかけています。

ICEとの連携がもたらすAI企業への不信感

MIT Technology Reviewは、ICE(米国移民・関税執行局)への反発が、AI企業全体に対するより広い不信運動へと発展していると報じています。ICEはトランプ政権下での移民取り締まり強化の象徴的な機関であり、その活動にAI技術が活用されているとされることが、多くの市民の反感を呼んでいます。

ロンドンでは、AIに反対する史上最大規模の抗議デモが行われたとMIT Technology Reviewは伝えています。英国においてもAIをめぐる社会的な緊張が高まっており、特定の企業や政府機関の問題にとどまらず、AI技術そのものの発展の方向性に対する異議申し立てとして運動が広がっている状況です。

AI企業が政府機関との連携を深めるほど、政治的な立場や政策方針との関係が問われやすくなります。ユーザーは単に便利なツールを使うだけでなく、その企業の姿勢や社会的影響に対して消費者として責任を問う意識を持ち始めています。企業にとっては、技術開発と並行して社会的信頼をどう維持するかが、経営上の重要課題になっています。

軍事AI開発が日本企業・社会に与える影響

米国でのAI軍事化の動向は、日本の企業や社会にとっても対岸の火事ではありません。グローバルに展開するAIツールやプラットフォームを業務で活用している日本企業にとっては、提供元企業の軍事契約や政府との関係が、自社のリスク管理や倫理方針にも影響を及ぼす可能性があります。

AI倫理ガイドラインと軍事利用の境界線

日本では内閣府や経済産業省がAI倫理に関するガイドラインを整備しており、「人間中心のAI」「安全性・透明性・公平性」といった原則が掲げられています。しかし、これらのガイドラインは現状として軍事利用を明示的に禁止・規制する内容にはなっておらず、境界線はあいまいなままです。

海外のAIサービスを業務に組み込んでいる日本企業にとって、そのサービスの提供元が軍事利用契約を結んでいた場合、自社の調達・利用方針との整合性が問われる場面が生じます。サプライチェーン上のリスクとして、AI倫理を考慮する必要性が高まっています。

また、日本国内でもデュアルユース(民軍両用)技術の開発や防衛省のAI活用が議論されています。民間技術をどこまで防衛分野に応用するかについて、国内でも早急なルール整備と社会的な合意形成が求められています。

国内企業が取るべき対応と注意点

日本企業が今取り組むべきことの一つは、利用しているAIサービスの提供企業の利用規約と倫理方針を精査することです。特に米国系大手AIサービスは、利用規約の改定で軍事・政府向け利用が拡大されるケースもあるため、定期的な確認が必要です。

また、社内のAI利用ポリシーに「軍事利用・政府機関向け利用に関連するリスクの把握」を明示的に盛り込むことが有効です。コーポレートガバナンス(企業統治)の観点からも、AIに関するリスク管理は取締役会レベルで議論されるべき課題になりつつあります。

さらに、QuitGPTのような消費者運動が日本でも波及する可能性を念頭に、顧客・パートナーからの問い合わせに対応できる説明責任体制を整えておくことが重要です。AI活用を推進しながら社会的信頼を維持するためには、透明性の高い情報開示が不可欠です。

まとめ:AIの軍事化時代に私たちはどう向き合うべきか

AnthropicとペンタゴンのClaude兵器化をめぐる対立、OpenAIの「機会主義的」な国防総省との契約、そして米国のイラン攻撃支援へのAnthropicの関与——これらの出来事は、「安全で倫理的なAI開発」を標榜してきた企業が、現実の地政学的・経済的圧力の前で大きく方向を変えつつあることを示しています。

QuitGPTキャンペーンやロンドンでの大規模抗議デモが示すように、ユーザーや市民社会もAIの軍事化に対して黙っていません。テクノロジーの恩恵を享受しながら、その暗部を見過ごすことへの抵抗感が、可視化された形で広がっています。

日本企業や個人にとっても、使用するAIツールがどのような目的に転用されうるかを意識することは、もはや他人事ではありません。AIの軍事化という潮流は今後も続くと見られており、個々人・企業・政府がそれぞれの立場でリスクと向き合い、判断基準を持つことが求められています。技術の進歩と倫理的な問いは、常に並走していく必要があります。

コメント